AI算力战争的真相:能源与算力的竞争

深入探讨GPT-5训练所需的电力消耗,揭示了在AI时代,能源和算力成为了新的竞争焦点。通过详细计算,GPT-5训练所需的能耗达到1亿度电,这相当于一个中型城市一年的电力消耗。文章进一步分析了为何微软、谷歌等科技巨头纷纷投资能源技术,并将电力视为算力和生产力的基础。

在现代人工智能的竞争中,算力已经成为衡量一个AI系统强大与否的关键。然而,随着模型的不断扩展,AI所需的算力和能源需求也在急剧上升。这不仅仅是技术上的竞争,更多的是一场关于能源和计算资源的战争。

今天,我们将通过一组数据来算一笔非常现实、也非常震撼的账——训练一次GPT-5要用多少电?

训练GPT-5的电力消耗

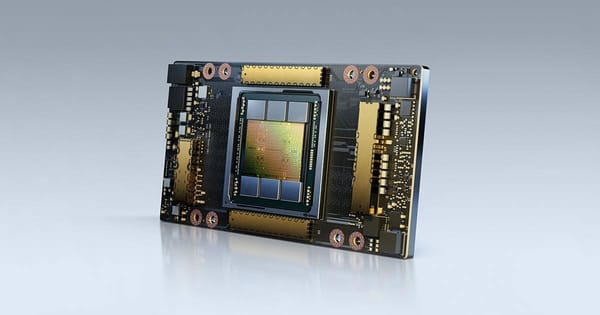

首先,我们从硬件规模开始分析。训练GPT-4时,使用了大约几万张A100显卡,而GPT-5的训练可能需要5万到10万张H100或B200级别的GPU。

GPU的功率消耗

一张H100的功率大约在700到800瓦之间,而B200的功率甚至可能接近1000瓦。我们取一个中间值,假设每张GPU的功率为0.9千瓦。

接下来,我们计算5万张GPU的即时功率:

- 50,000张GPU × 0.9千瓦 = 45兆瓦(即时功率)

训练周期与总能耗

GPT-3的训练周期为34天,GPT-4则需要几个月。根据合理推测,GPT-5的训练周期可能会达到60到120天。我们按90天(2160小时)来计算训练时间。

因此,总能耗计算如下:

- 45兆瓦 × 2160小时 = 97200兆瓦时(即0.972 TWh)

接着,我们需要考虑到数据中心的能效损耗。微软或谷歌的数据中心PUE(电力使用效率)大约为1.2。

最终,GPT-5训练的总能耗为:

- 97200兆瓦时 × 1.2 = 116640兆瓦时(即0.116 TWh)

能源换算与现实意义

1 TWh(太瓦时)等于10亿度电。因此,0.116 TWh等于1.16亿度电。

这意味着,GPT-5训练一次所需的电量大约是:

- 相当于一个县城一整年的用电量

- 相当于2万户家庭全年用电

- 相当于一座中型水电站的年发电量

- 等同于1万辆电动车跑一年

- 相当于点亮上千万盏LED灯连续一年

这些数字听起来可能有些抽象,但它们反映了一个事实:训练一个先进的AI模型已经不是简单的计算任务,而是一个巨大的能源消耗过程。

上线后的推理与能源挑战

虽然训练阶段的能源消耗已经非常庞大,但更大的挑战来自AI模型上线后的推理阶段。AI在实际应用中每天将进行几千万到几亿次的调用,24小时不停运行,这意味着能源的消耗将持续增加。

从这一刻开始,AI的竞争不仅仅是算法的竞争,而是能源和算力的竞争。这也解释了为什么全球科技公司都在布局能源解决方案:

- 微软投资核能,以应对日益增长的电力需求。

- 谷歌正在投资巨变的能源方案,以支持其庞大的数据中心。

- 特斯拉建造了自己的AI训练平台——Dojo,并自建储能系统,以确保电力供应不受限制。

电力就是算力,算力就是生产力

进入AI时代,电力不再是简单的资源,而是算力的基础,而算力本身也正变成生产力。算力决定了一个公司在AI领域的竞争力,而能源,作为支撑算力的核心要素,正在变成一种新的货币。

随着AI技术的不断发展和应用场景的拓展,能源将成为下一代科技竞争中的重要一环。如何确保充足的电力供应,如何通过创新的能源解决方案来支撑巨量的算力需求,将成为未来竞争的关键。

解锁AI算力,上晨涧云AI算力平台,多种GPU租用选择,极具性价比的A100、4090、3090显卡资源。

结语

随着AI计算需求的不断增长,能源和算力的竞争将变得更加激烈。未来的科技公司不仅要在技术上取得突破,还需要在能源的获取与利用上做好充分准备。电力就是算力,而算力决定了未来科技的竞争力。

在这场AI算力战争中,谁能先行一步,占领能源和算力的高地,谁就能在未来的科技竞争中占据优势。