算力的终极博弈,是电力

本文从数据中心用电、变压器交付、电网瓶颈等角度出发,讨论了算力竞争逐渐演变为电力与基础设施竞争的趋势。分析了科技巨头为何开始自建和锁定电源,以及中国在特高压输电、能效优化和算力流入实体经济方面的系统优势,指出“电力—算力—生产力”的完整链路将决定未来 AI 竞争格局。

这两年,如果你留意英伟达、OpenAI、特斯拉这些公司,会发现一个有意思的变化:

他们在公开场合谈显卡、谈参数的频率,反而没那么高了,越来越多开始谈一个听上去很“传统”的词——电力。

甚至有传闻说,英伟达在加州圣克拉拉开了一场闭门会,不是叫来芯片公司,也不是叫来大模型公司,而是一群搞电网、修变压器、铺电缆的“老基建人”。这本身,就是一个信号:

算力战争,正在从“谁的卡更强”,转向“谁的电更稳、谁能长期供电”。

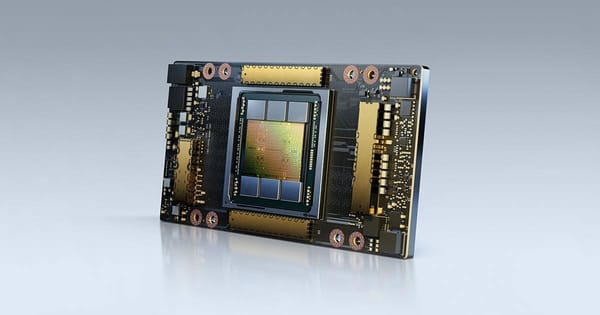

如果你手里有几万张 H100,却迟迟插不上电,它们就只能是几万块昂贵的加热器。这不是比喻,而是现实的物理约束。

一、数据中心用电:真正的大数字

国际能源署曾给出一个预测:

全球数据中心用电量将从 2025 年的约 450 太瓦时,增加到 2030 年左右的 950 太瓦时,增加了 500 太瓦时。

500 太瓦时是什么概念?

- 相当于多座大型水电站全年满负荷运转

- 相当于多个中等发达国家一年的全社会用电量

更现实的问题是:

发电未必是最大瓶颈,输送和接入才是。

二、显卡三个月到货,变压器两年到位

在算力产业链和电力基础设施之间,存在一个非常残酷的时间错配。

- 你下单一批 GPU,从付款到收货,可能是三到六个月

- 你要采购一台支撑“几万张卡”的高压主变压器(GSU),现在的交付周期经常是一百周起步,也就是两年左右

这意味着,即便今天你有充足的预算,机柜、服务器、网络设备都已经就位,未来很长一段时间里,真正卡住你的可能只有一件事:

高压侧设备迟迟到不了,电就是送不进来。

从电网并网审批,到变电站扩容,再到园区配电、机房母线、机柜 PDU,整个链路任何一环没打通,算力就只能停留在 PPT 和财报里。

三、为什么科技巨头开始“亲自下场搞电”

面对这个瓶颈,头部科技公司已经不满足于“买电”,而是在抢“电源”。

常见的几种做法包括:

- 和核电站、风电场签长期购电协议,甚至直接参与电源侧投资

- 抢购小型模块化反应堆(SMR),希望把稳定电源尽量“绑死”在自己名下

- 在数据中心园区旁自建燃气轮机机组,变成局部意义上的“自备电厂”

背后的逻辑并不复杂:

稳定的电力交付能力,正在变成算力时代的“货币发行权”。

如果把 GPU 看成“印钞机”,那么电网和能源系统,就是这套体系背后的“中央银行”:

- 电来得上来,GPU 才具备实际算力价值

- 电来不上来,所有芯片都只是账面资产

这也是为什么一些企业在内部规划中,会把“电力交付”当成和“算力部署”同等级的核心指标,而不是简单归为能源成本。

四、电力交付链:从电网到芯片的物理路径

要让一块 GPU 真正发挥价值,至少要跑通这样一条链路:

- 上游电源并入主电网

- 通过长距离输电和区域电网调度,送到数据中心所在区域

- 在变电站完成降压与切换,进入园区配电系统

- 通过配电柜、母线、PDU 分发到每一个机柜

- 机柜内部再经过电源模块,最终以稳定电压电流喂到每一块 GPU

任何一段出问题:

- 电压波动过大

- 短时中断频繁

- 散热无法跟上

算力都会直接“蒸发”。

所以,算力不只是“买卡”的问题,而是整条电力—冷热—机房—集群系统工程。

五、中国的优势:不只是“基建狂魔”

在电力与算力的结合上,中国的优势往往被简单概括为“基建快”“装机多”。但如果展开看,会发现至少有三层更底层的逻辑。

1. 特高压:把能源输出地“搬”到算力需求侧

美国很多数据中心不得不建在电厂旁边,因为老旧电网跨区域输送能力有限,长距离送电损耗大、瓶颈多。

而中国在很早之前就大规模铺设了特高压输电网络,可以把西部的风电、光伏、水电,打包成“绿电包裹”,在毫秒级调度下跨越几千公里,精准送往东部负荷中心。

这不只是电力工程问题,而是实实在在的算力基础设施问题:

- 算力机房可以更多选址在靠近产业、靠近数据源的地方

- 电力不必被动跟着算力跑,而是通过特高压主动支撑算力布局

2. 把电力交付当成“工程变量”来优化

国内不少互联网企业、云厂商,已经不满足于只是“买机房、租电力”,而是直接参与:

- 变电站标准的制定和优化

- 机房级供配电系统设计

- 节能技术和能效指标的持续调优

目的很简单:

把原本高度不确定的电力交付,变成可预测、可扩展、可优化的工程变量。

再叠加上对芯片能效、服务器能效的优化,通过算法、系统软件和集群调度,把单位算力的能耗不断压下来,算力的“能效比”才真正有机会跑赢电价曲线。

3. 做真正的闭环:电力→算力→生产力

从更长周期看,算力的终点并不是“多一个聊天机器人”或“多几个炫酷 demo”,而是:

- 用在工厂里,提升自动化和良率

- 用在电网里,优化调度和负荷预测

- 用在交通、物流、医疗、金融等实体行业

只有把“电力—算力—生产力”这条链路真正跑通,每一度电才会转化成可复利的 GDP,而不只是“多跑完几次大模型训练”。

六、算力之争,最终是基础设施与系统能力之争

表面上看,全球在比的是:

- 谁的 GPU 更先进

- 谁的大模型参数更多

但在水面之下,真正比的是:

- 谁能在限定时间内,稳定交付几百兆瓦甚至千兆瓦级别的电力

- 谁能把变压器、并网、配电、散热、运维、融资这一整套链条跑顺

这已经不是单一企业的竞争,而更像是一次“第四次工业革命的入场券”之争。

从这个角度看:

- GPU、AI 模型,是算力时代的“前端表现层”

- 电网、发电、特高压、冷却系统,才是决定谁能长期玩下去的底层结构

晨涧云依托专业的 IDC 机房,提供高效稳定的 GPU 租赁服务,释放真正强大的AI算力。

结语

算力这场战争,短期看是显卡市场的狂欢,长期看是电力体系的重构。

显卡可以在一个产品周期内迭代两三代,但一条特高压线路、一座大型变电站、一个区域电网的升级,往往要以十年为时间单位来规划。

谁能在这条长期赛道上,把“电力—算力—生产力”这条物理和经济链路真正打通,谁才有资格在下一轮 AI 竞争中站在更高的起点上。

对于身处这一轮变革中的我们来说,理解这套物理逻辑,比盯着显卡规格表多看几行参数,可能更重要。