RTX 3080 20GB 魔改版评测:便宜大显存,究竟香不香?

本文评测了 RTX 3080 魔改版 20GB 显卡在 AI、生图和大模型推理场景下的实际表现。魔改卡在保持 3080 级别算力的前提下,通过 20GB 显存与 4090 级散热器,显著改善了大模型与高分辨率内容创作体验,尤其在 14B、30B 模型的 AWQ 推理中优势明显。更适合大模型推理、需要较大显存的场景。

这两年,随着 AI 大模型、本地推理和生图工具的普及,“显存焦虑”成了不少人装机时的第一反应。

一边是官方 8GB、12GB 显存的新时代“祖传配方”,另一边,是各种来自小厂、代工厂、甚至 AIC 代工线下来的魔改显卡:3080 20GB、4080 32GB、4090 48GB 等。

这一类卡的思路很简单:

拿游戏卡核心,重新做 PCB 和散热,把显存焊满,卖给有 AI 需求但预算有限的人。

这篇文章只关注一个问题:

- RTX 3080 魔改版 20GB,在 AI、大模型、本地推理 这些场景下,到底值不值得买?

晨涧云AI算力平台有 3080 20G 魔改版显卡可以租用,超高性价比的AI推理卡选择。

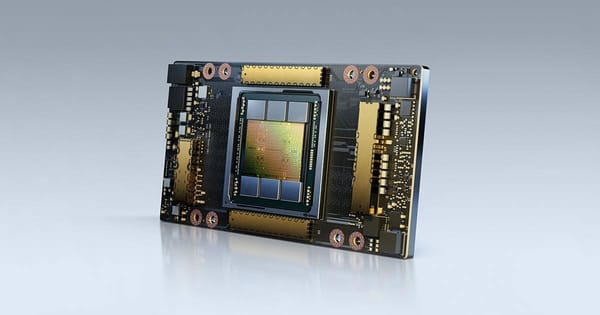

一、这张 RTX 3080 20GB 是什么来头?

先把卡的背景信息讲清楚。

- 名义型号:RTX 3080 20GB

- 品牌:风破(商标背后公司为“创育云智算科技有限公司”)

- 定位:面向 2B 端的“AI 卡”,却做成了零售游戏卡外观

- 形态:三风扇、三槽厚度,标准 3×DP + 1×HDMI 输出,适合装在普通台式机里

从拆解可以看到,这并不是随便拿旧卡改一改,而是:

- 用 全新 PCB,显存正反面各焊 10 颗 1GB 美光 GDDR6X,合计 20GB

- 核心是正经 GA102-200,对应量产版 RTX 3080 GPU

- 外接供电直接做成了 16pin 12VHPWR,而不是传统 8pin 接口,显然是照着 40 系卡的供电方案走的

更有意思的是散热器。

这块卡使用的是一整套 PNY RTX 4090 原装散热模组:VC 均热板 + 9 根热管 + 高规格鳍片,核心和显存共用一块大均热板,背板也完整覆盖导热垫。

一句话概括:

这是把 GA102 核心和 20GB 显存,塞进了 4090 级别散热器的 3080 魔改版。

至于核心来源,拆解信息显示批号为 2021 年第 7 周,显然是一批沉睡多年的 GA102 库存。

二、核心规格与散热表现:标准 3080 核心,极度过剩的散热

先看一下几项关键参数(以主流 3080 20GB 魔改卡为例):

- 架构:Ampere(GA102-200)

- SM 数量:68 个(和 3080 10GB 一致)

- 显存:20GB GDDR6X,320bit 位宽,等效带宽约 760GB/s

- 外接供电:16pin 12VHPWR

- 理论功耗墙:约 320W(BIOS 锁定,无法像高端非公那样轻松冲到 380W +)

散热测试则非常夸张:

在 27度 室温下,用 FurMark 长时间烤机:

- 核心温度只有 50度 出头

- 热点温度 60度 出头

- 显存温度约 74度

对比一张换过高端导热垫的普通 3080 10GB:

- 同样场景下显存能直接冲到 98度,接近 100度,几乎顶到 GDDR6X 的极限

温度直接拉开了一个时代。

对于要长时间跑大模型、常驻高负载的用法来说,温度低不仅是“更安静”,更是 稳定性和寿命的核心保障。

三、和 16GB 新卡的对比:显存不是多 4GB 那么简单

在消费级显卡里,目前能买到的“相对便宜的大显存卡”,主要有两类:

- 各家 16GB 卡(4060Ti、5060Ti 16G 等)

- 魔改类 20GB、22GB、24GB 卡(3080 20G、2080Ti 22G 等)

很多人会问:

16GB 和 20GB,看起来就差 4GB,真有那么大差别吗?

在游戏里,差别有时确实不大。 但在 AI 和大模型场景中,这 4GB 经常是 能不能用 的差距,而不是体验好坏的问题。

Qwen2.5 14B Q8 实测:16GB 已经在边缘

在一套 Ubuntu + 64GB 内存的平台上,使用 Qwen2.5 14B Q8 量化模型做本地推理:

- 在 5060Ti 16G 上,模型可以勉强放进显存,但推理过程中只能输出两千多 Token,上下文长度几乎被一次回答吃满,再想继续追问就会很难受

- 换成 3080 20G 后,同样的模型可以完整放入显存,输出一万多个 Token 仍然比较从容,对话可以持续很多轮,不必频繁重置会话

对于代码生成、长文总结这类任务,16GB 在 Q8 精度下已经非常吃力,而 20GB 至少还能保证:

- 模型不需要频繁 offload 到内存

- 上下文可以适当加长

- 实际使用体验接近“正常可用”

这里还有一点很关键:

为什么坚持用 Q8,而不是 Q4?

实测表明,Q4 虽然可以在 16GB 显存里塞下更大的模型,但在编程、算法等场景下,错误率和“胡说八道”的情况明显更多。

如果你是要拿模型“干活”,而不是只看能不能跑出来,Q8 这种较高精度的方案会更可靠。这时候,20GB 显存的价值就比纸面数字更明显。

四、vLLM 实测:3080 20G 在 AWQ + Marlin 下的真正优势

另一份针对本地大模型的测试,是用 vLLM 对比了三张卡:

- RTX 2080Ti 22GB

- RTX 3080 20GB

- RTX 4060Ti 16GB

测试重点放在几种主流精度和量化方案:

- BF16:几乎等价原始精度,显存占用最大

- W8A8:8bit 权重 + 8bit 激活

- AWQ 4bit:需要 Marlin 这类算子才能跑快

- FP8 / LP8:40 系及以上才支持

结果可以概括成几条结论。

1. 4B 模型:三张卡都能跑,3080 20G 稍占优

在 4B 级别模型上:

- BF16 下 2080Ti 和 3080 性能接近,4060Ti 略低

- W8A8 下 2080Ti 最快

- AWQ 下 3080 20G 拿到第一,2080Ti 因为架构老、吃不上 Marlin,性能明显落后

这一段说明:

- 图灵架构靠大显存和老牌算力,在高精度下还有一定优势

- 但一旦引入专门为 int4 设计的加速算子,Ampere 的架构优势开始显现

2. 8B 模型:本地部署的甜点区,3080 20G 是更稳的选择

到了 8B 模型:

- 在 BF16 下,22GB 显存的 2080Ti 还能凭显存优势压制 3080,4060Ti 直接爆显存

- 在 W8A8 和 AWQ 下,3080 20G 反超,以 8.07 token/s 左右的吞吐排在第一,2080Ti 略低,4060Ti 再次垫底

- 在 LP8 下,只剩 3080 和 4060Ti 能跑,二者速度接近,但 4060Ti 在功耗上有优势

综合来看:

- 8B 是很多人本地部署的常用规模

- 如果优先考虑吞吐和兼容性,3080 20G 在 AWQ + Marlin 组合下,目前是更平衡的方案

3. 14B / 30B 模型:显存和架构缺一不可

当模型扩展到 14B、30B:

- 4060Ti 16G 显存不够,只能跑 AWQ,很多高精度格式直接无解

- 2080Ti 22G 显存足够,但架构老,吃不上 Marlin,在 AWQ 下明显跑不动

- 3080 20G 成为唯一一个既能放下模型,又能利用新算子提速的选项

实测中,30B 级别的 AWQ 模型在 3080 20G 上仍能跑到约 1 token/s,虽然不快,但已经从“跑不起来”变成了“慢但能用”的级别。

这意味着:

对于想在单机上尝试 30B 模型推理的人来说,3080 20G 大概是当前“能接受的最低门槛”之一。

五、除了大模型,20GB 显存在内容创作中也确实有用

虽然我们刻意把游戏测试略过,但视频剪辑这类偏内容创作的场景,和 AI 属于同一类“显存敏感工作负载”,值得一提。

以多轨 4K60 视频剪辑为例:

- 把多路 4K60 素材全部拖到时间轴上,显存占用可以轻松拉到 12.8GB

- 在 3080 20G 上,进度条拖动、预览都比较顺畅

- 换成 8GB、10GB 显存的卡,在同样项目里就很容易卡顿、掉帧、甚至直接崩溃

对剪辑长视频、4K / 8K 项目的人来说,大显存在很多时候意味着:

- 不需要频繁做代理文件

- 不用因为担心显存而降低预览分辨率

- 整体工作流会顺得多

对于既想跑模型、又要兼顾视频活的个人和小团队,这类卡的复用价值不低。

六、风险与定位:它适合谁,不适合谁?

从测试和拆解看,这类 3080 20GB 魔改卡有几个很明确的优点:

- 显存从 10GB 拉到 20GB,对 14B、30B 模型、本地高精度推理非常关键

- Ampere 架构支持 BF16、Valid AWQ + Marlin 等组合,在 vLLM 等现代推理框架下性能不错

- 套了 4090 原装散热,温度表现极其夸张,显存从“接近 100度”压到了 70度 出头

- 二手价位通常对标一些 16GB 新卡,但性能和显存都更有优势

但与此同时,风险也非常明确:

- 核心来自 2021 年库存,严格意义上算“翻新利用”,不是英伟达官方 SKU

- 品牌体量有限,售后政策往往是“第一年免费,第二年起要付配件费,第三年还要加人工费”,可靠性和官方大厂不可同日而语

- 三槽厚度、16pin 供电、偏高功耗,对电源和机箱空间都有一定要求

所以,更现实的结论是:

- 适合的人:

- 已经有一定硬件经验,敢于接受魔改卡不确定性的老用户

- 希望在单机上跑 14B、30B 模型,做本地推理与开发的人

- 需要显存同时兼顾 AI、生图、视频剪辑的个人工作站场景

- 不适合的人:

- 完全没有硬件经验的小白用户

- 期望“插上就有三年无脑质保”的传统消费级用户

- 只想玩游戏、不跑模型的人(对他们来说,原生 3080 或新一代 50 系更简单)

结语:3080 20GB,更像一块“打折进阶工作站卡”

如果只看纸面参数,这类 3080 20GB 魔改卡确实充满“灰色地带”气质:非官方型号、魔改显存、复用散热器、二手核心。

但从实测结果看,它扮演的角色非常清晰:

- 用 3080 的算力撑起 20GB 显存

- 借 4090 级散热把温度和稳定性拉到一个相当高的水平

- 用相对可控的价格,填补“16GB 不够用,真正专业卡又太贵”之间的那块空白

对于认真做本地 AI、大模型和内容创作的人来说,它不像是一张“玩票的魔改卡”,更像是一块 打折的入门推理卡。

值不值得买,取决于你是否清楚它的来源、风险,以及你是否真的能用得上那多出来的 4GB 显存。