算力真能打赢 AI 战争吗?

从英伟达 H100 和 DGX-H100 超算入手,解析算力在 AI 时代为何被视为“新型能源”,并以 DeepSeek R1 为例,展示算法优化如何在有限算力下撬动成本与性能,对“算力即胜负”的观点提出反思。最后指出:算力重要,但真正决定 AI 竞争格局的是算力、算法、数据、产业链与人才的综合实力。

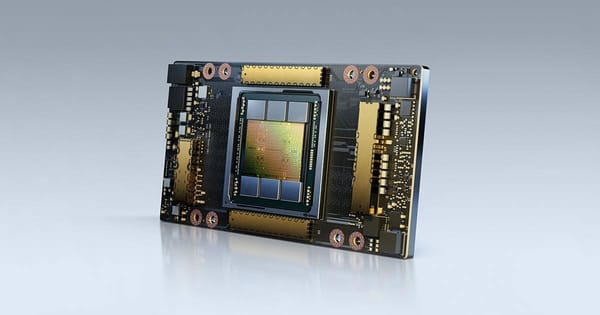

2025 年,一张英伟达 H100 GPU 的价格在 3.5 万到 4 万美元之间。

这一块看起来“就一块电路板”的硬件,被马斯克买了十万张,用来搭建名为 Colossus 的超级计算机,为 XAI 的大模型 Grok 提供算力,短时间内就把模型推到了世界顶级水平,也开始实实在在地赚钱。

在很多人眼里,H100 就是 AI 时代的“石油”和“电力”。有了足够的 H100,就能打赢这场 AI 战争。

真的是这样吗?

这篇文章想从头梳理一遍:算力到底是什么,为什么 H100 会变成全球争抢的战略资源,DeepSeek R1 又是怎么用“平民算力”撼动这个共识的。最终回到那个核心问题:

在 AI 时代,算力是不是唯一的王?

一、H100:AI 时代的“燃料棒”

先从这张 H100 说起。

一张 H100 的核心,是面积 814 平方毫米的 GH100 芯片,里面密密麻麻分布着 144 个 SM(Streaming Multiprocessor,流式多处理器)。

每个 SM 中包含多种核心单元:

- 第四代 Tensor Core,用于深度学习中的矩阵运算

- FP32 CUDA 核心,用来做常规单精度浮点计算

- FP64 核心,用于双精度计算

FP64 是什么概念?

它是一种可以处理高精度数据的计算核心,典型应用包括:

- 气候模拟

- 金融量化分析

- 高精度自动驾驶仿真

一张 H100 上,大约有 8,448 个 FP64 核心。

而在同一代的消费级旗舰卡 RTX 4090 上,只有区区 288 个 FP64 核心。差距不是一星半点。

换句话说,同样一份复杂的仿真任务:

- H100 可能一天就算完了

- 4090 可能得算三个月

这也是为什么 H100 不仅“卖爆了”,还直接上升为各国争抢的战略资源。

二、从一张卡到一个算力中心

如果你有幸真的拿到了几张 H100,会发生什么?

- 把 8 张 H100 和 CPU、DPU、交换芯片、存储、散热等硬件组装在一起,你会得到一个金光闪闪的盒子:DGX-H100。

- 把 32 台 DGX-H100 放进机柜,你就有了一排小型算力集群。

- 再把一排排机柜塞进一个巨大的厂房,你就拥有了一个数据中心——一个 AI 时代的“发电厂”。

但算力中心不是只有 GPU,本质上是一整条工业链的集合:

- 上游:电网、储能系统(超大号“充电宝”)、变电和配电系统

- 机房:机柜、电源分配单元(PDU)、冷却系统(风冷 / 液冷 / 浸没式)

- 网络:交换机、光模块、光纤光缆

- 板级:PCB、电源模块、各种高速接口

甚至是那一颗颗不起眼的光模块,只占数据中心 3%~5% 的成本,却撑起了好几家市值千亿级的企业。

所以,GPU 只是“算力能源”的基础单元。

真正的 AI 工业革命,是围绕整个算力基础设施展开。

晨涧云AI算力平台 提供高效的算力租赁服务,多种显卡资源选择,主打性价比和易用性,刚接触AI算力使用的可以试试。

三、算力真的是 AI 的唯一护城河吗?

看完上面这套“金色 DGX”叙事,很容易得出一个简单粗暴的结论:

谁能买到更多 H100,谁就能打赢 AI 战争。

这个结论在相当长时间里,几乎成为行业共识。OpenAI 从 GPT-1 到 GPT-4,大模型的参数量一路飙升,从 1.17 亿到万亿级别,训练用的 GPU 数量也从几块卡增加到几万块 A100,训练时间动辄 90~100 天。

在这样的叙事里,算力几乎等同于“脑力”,堆得越多、堆得越快,就越有希望领先。

直到 2025 年 1 月,DeepSeek R1 出现,让这套等式第一次被大众认真质疑。

四、DeepSeek R1:用“平民装”撕开一道口子

DeepSeek R1 做了几件颇具颠覆意味的事:

- 它没有用最新的 H100,而是用被阉割的中国特供版 H800

- 用了 512 张 H800,训练 80 小时

- 训练成本约 29.4 万美元

- 性能却逼近甚至对标 GPT-4 这一档的大模型,引发全球关注

更关键的是,它的商业模式也没有走“烧钱换规模”的路子。

DeepSeek 官方公开过一组 24 小时的收入与成本数据(针对 V3 / R1 推理系统):

- 当天总收入约 56 万美元

- 租用 H800 的算力成本约 8.7 万美元

- 也就是说,用 3 个小时就能把一天的成本赚回来

- 成本利润率超过 500%

这一点和很多还在“疯狂烧钱”的大模型形成鲜明对比。

为什么在同样受限的算力条件下,DeepSeek 可以做到“便宜、好用、还赚钱”?

关键在于,它在 算法和系统层面做了很多优化。

五、算法 vs 算力:不是非此即彼,而是螺旋上升

DeepSeek V3 的技术报告里,给出了几条核心思路:

- 采用 Mixture-of-Experts(MoE,混合专家)架构,让模型在每次推理时只激活部分专家网络,从而在不牺牲表现的前提下降低计算开销。

- 使用 MLA 等架构优化,在推理和训练环节进一步压缩无效计算。

可以粗暴理解为:

别人还在“全模型全开火”硬算,DeepSeek 已经在“挑着用脑子”,只算真正有用的部分。

这并不是投机取巧,而是一次真正的算法创新。相关工作被顶级期刊和媒体持续报道,也让“算力至上”的叙事第一次出现明显裂缝。

但这并不意味着算力就不重要了。

更接近现实的说法是:

- 算法创新需要一定的算力基础来验证与迭代

- 算力的提升又会反过来逼迫算法继续优化,否则成本失控

- 二者是一种 螺旋上升 的关系,而不是“谁干掉谁”

六、推理模型:算力需求在另一端被拉高

算法优化真的能“省算力”吗?

能,但只说了一半。

从 GPT-4 开始,业界开始更多讨论“推理模型”(reasoning model)与链式思考(Chain-of-Thought)。DeepSeek R1、Kimi K1.5 等模型,都把“推理能力”当成卖点。

区别在于:

- 传统大模型:

- 大量算力花在预训练和微调阶段

- 真正回答用户问题时,反而计算量有限

- 推理模型:

- 在交互时也会花大量算力进行“思考”

- 你看到的是那一串串“深度思考中”的灰色小字

举个简单的类比:

- 普通模型:你问“怎么给视频点赞”,它直接拍脑袋说“点右下角大拇指”。

- 推理模型:会先分析你在哪个平台、看什么视频、点赞入口在哪,综合上下文再做决策。

这意味着,推理阶段本身就会消耗更多算力。

所以,当我们一边用算法把训练成本压下去,另一边又用推理模型把使用阶段的算力需求推上去,整体算力需求并不会自然下降,甚至可能持续增长。

七、数据:AI 革命跑到“库存见底”的拐点

算力和算法之外,还有一个经常被忽略的变量:数据。

有研究指出,按照当前的训练规模和互联网上高质量文本的库存速度推算,AI 训练用的公开文本数据将在数年内被“学完”。

这会带来几个趋势:

- 通用网络文本的边际价值开始下降

- 高质量、结构化、领域专有的数据价值上升

- 模型会更多走向两个方向:

- 面向物理世界的多模态 / 智能体

- 面向行业场景的垂直小模型

比如:

- 自动驾驶依赖真实道路和极端场景数据

- 医疗 AI 需要结构化医疗记录、影像数据

- 工业和机器人需要大量传感器、动作与反馈数据

这一切都意味着,AI 不会永远停留在“只和文本对话”的阶段,而会越来越深地进入物理世界,与人和环境发生真实交互。

八、算力战争背后,其实是产业链与人才战争

当我们把视野从单纯的“显卡大战”拉远一点,会发现 AI 战争本质是 产业链和人才的综合较量。

1. 三层结构:基础层、技术层、应用层

可以粗略把 AI 产业拆成三层:

- 基础层:

- 算力(数据中心、云计算、AI 芯片)

- 算力配套(电力、储能、冷却、光模块、网络)

- 数据(采集、标注、存储、治理)

- 技术层:

- 大模型和开发平台

- 各类通用技术:CV、NLP、语音、知识图谱、推荐系统、强化学习等

- 应用层:

- 行业应用:医疗、金融、教育、工业、零售、交通、物流等

- 终端形态:人形机器人、AI 手机、AIPC、无人机、无人车、AR/VR 等

从过去几年的融资数据看,行业应用的融资金额已经超过了基础层和技术层的总和,说明资本和市场的注意力已经开始向“落地场景”倾斜。

2. 中国的现实位置

从锂电池到新能源汽车,中国的优势在于:

把一项技术从论文里“拧成”一个完整产业的能力。

AI 也类似:

- 中国在算力基础设施上进展很快,智能算力规模已占全球较大份额

- 多家互联网与科技企业建设了数十 EFLOPS 级别的智算中心

- 在应用层的想象空间更大,尤其是在制造业、交通、城市治理等场景

黄仁勋曾说,全球约 50% 的 AI 研究人员是华人。

无论站在哪一侧,这都是一个不容忽视的现实。

九、对普通人来说,AI 是夺命镰刀还是一次新风口?

每次技术革命,都会伴随着“工作被取代”的恐慌。

历史上消失的职业很多:

- 切冰人:冬天从湖面切冰块,夏天供冷藏,冰箱普及后自然消失

- 电报员:要背上千个电码,电话普及后成为历史

- 点灯人:城市煤气灯时代的专职人员,电灯一普及就没了

但这些职业本身,也是技术进步的产物。

没有电报,就不会有电报员;没有报纸,就不会有读报员。

同样的:

- 没有计算机和互联网,就没有程序员

- 没有智能手机,就没有 App 开发者和移动运营岗位

技术确实会吞掉旧岗位,但也会创造新岗位。

关键不在于“工作会不会被替代”,而在于“你是否有机会站在新的技术浪潮里”。

AI 也是如此:

- 基础设施层,催生了一大批算力运维、芯片工程师、冷却与电力工程岗位

- 模型层,需要大量数据工程师、模型工程师、AI 平台开发者

- 应用层,则涌现出各种与行业结合的“AI+X”岗位

从招聘数据来看,人工智能工程师的平均薪资已经站在了所有职位的前列,甚至超过很多传统的高管岗位。

十、结语:算力重要,但决定胜负的不是算力一项

回到最初的问题:

算力真能打赢 AI 战争吗?

如果只看短期,很容易被 H100、DGX、超级数据中心的叙事吸引,觉得只要能多堆几排机柜,就能赢下未来几十年的 AI 战争。

但 DeepSeek R1 的出现提醒我们:

- 算力是必要条件,却不是充分条件

- 算法创新可以在一定程度上“弯道超车”

- 数据、场景、工程能力和人才储备,同样决定一个国家、一家企业能走多远

更重要的是,AI 不是一场零和博弈。

它更像是一块新的“文明底座”,是数字版的水、电、燃气。

真正值得我们关心的,也许不是“谁赢了”,而是:

- 我们能不能用这波技术,把更多枯燥的劳动交给机器

- 把有限的时间,从重复工作解放出来

- 去做一些更有创造力、更有想象力的事情

算力,是 AI 这场革命中最显眼的硬件符号。

但真正改变世界的,往往是那些在算力、算法、数据和应用之间,搭起桥梁的人。