AI Agent

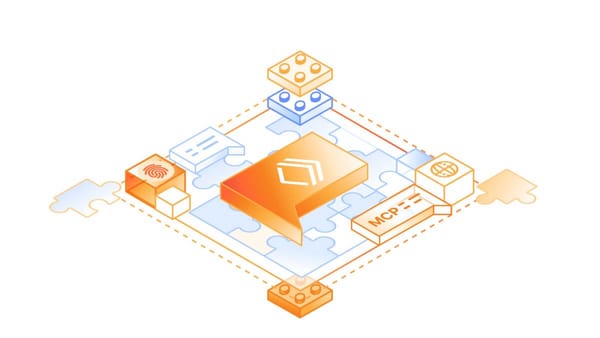

Agent Skill 从使用到原理:大模型时代的「说明书系统」

介绍了 Agent Skill 的概念、基本用法和内部机制,解释三层渐进式披露:元数据、指令以及 Reference/Script 资源层。对比了 Agent Skill 与 MCP 的角色差异,指出 MCP 更适合提供底层外部数据和能力,而 Agent Skill 更适合封装高频任务流程,在实际工程中需要配合使用。

AI Agent

介绍了 Agent Skill 的概念、基本用法和内部机制,解释三层渐进式披露:元数据、指令以及 Reference/Script 资源层。对比了 Agent Skill 与 MCP 的角色差异,指出 MCP 更适合提供底层外部数据和能力,而 Agent Skill 更适合封装高频任务流程,在实际工程中需要配合使用。

AI算力

本文梳理了算力从芯片、本地计算到云计算的发展过程,解释了 AI 时代算力需求为何远超摩尔定律,引发全球“算力战争”。对比了中美在算力布局上的不同路径,并解析欧洲、日本的差异化策略,重点讨论太空算力在能源、散热和效率上的潜在优势。强调算力既是国家战略资源。

AI算力

A100显卡价格暴跌超50%,40GB版2.8-4元/小时,80GB版4-6.5元/小时,包月9800-30000元。相比H100便宜70%,显存40-80GB适合大模型微调和推理。国产昇腾910B月租2万元形成竞争。供给充足、推理需求上升、价格战常态化。短期项目按需计费,长期包月省20-50%。

AI算力

AI算力租赁是云端共享显卡服务,按需计费无需购买硬件。2026年中国市场规模达2600亿元,年增速20%以上。分为云巨头(阿里云、腾讯云)、专业平台(AutoDL、晨涧云)和差异化平台三类。推理需求占比上涨,国产芯片加速替代。从"买卡"到"租服务",从裸算力到MaaS,AI算力成为新型基础设施。

AI算力

根据VideoCardz对10个国家和地区的14款当代显卡最低现货价格统计,过去三个月间全球显卡价格平均上涨15%。RTX 5090全球均涨32%,RTX 5070 Ti紧随其后,均涨25%。中国国内,涨幅最高的反而是RTX 5060 Ti 16G,达23.08%。AMD和Intel整体表现较为克制。

AI大模型

梳理了大语言模型中的 Token 和 Embedding 概念,解释模型为何先通过 Tokenizer 将文本转为离散编号,再用 Embedding 将编号映射到高维向量空间。对比语言模型内部的 Token Embedding 与 RAG 场景中的文本 Embedding,说明二者在架构相似但训练目标和用途不同。

AI算力

2025年GPU算力租赁市场突破千亿规模,但价格大幅回落超70%。市场从"抢卡"转向"拼交付",推理需求快速崛起预计2028年占比达73%。企业竞争焦点转向异构调度、绿色能效和生态服务能力。东数西算与算力券政策强力引导,液冷技术使PUE降至1.1,行业迈向高质量发展阶段。

AI Agent

本文从 Prompt 入手,梳理了 Agent 如何通过工具完成实际操作,以及 Function Calling 如何标准化工具描述。重点介绍 MCP 作为模型外部工具层通信协议的角色,并与 Anthropic 的 Skills 进行对比,指出二者本质差异在于“对模型的信任程度”与复杂度取舍。

AI Agent

Agent Swarm不是"集群"而是"蜂群"——通过彼此影响、自组织产生涌现智慧。Agent Teams用16个AI蜜蜂两周写出C编译器,验证了2026年AI主线:Orchestration编排架构。Qwen3 Coder Next以长上下文、强Agent能力成为蜂群关键拼图,证明这不是炒作而是范式转变。

AI算力

本文围绕近期出现的 32GB 魔改版 RTX 5080 显卡展开,梳理了其来源、改装方式及面向的本地 AI 运算市场。解释了为何在大模型推理场景下,显存容量往往比纯算力更关键,以及 32GB 版 5080 如何以低于 5090 的成本填补高显存需求空档。

AI大模型

本文通过Base64解码、古诗词创作、逻辑推理、UI复刻、游戏开发、Bug排查等多维度实测对比刚刚发布的Claude Opus 4.6和GPT 5.3。Opus 4.6在UI设计和可视化方面表现突出,拥有100万Token超大上下文;GPT 5.3 Codex则在代码规范、响应速度上领先,且成本降低50%。

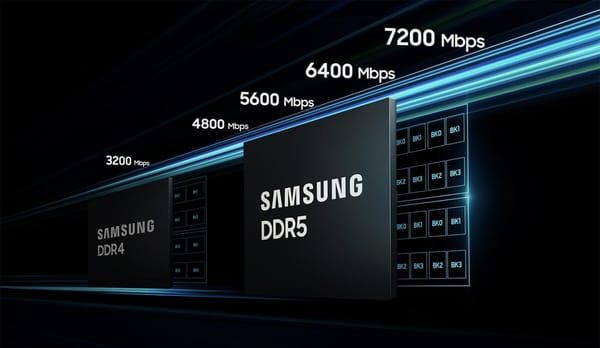

AI算力

自 2025 下半年以来,DDR5 和服务器 DRAM 价格出现 400%–500% 的历史级暴涨,AI 服务器与 HBM 抢占了绝大部分先进产能。本文从 AI 军备赛、HBM 产能挤压、DRAM 定价逻辑变化和厂商策略等角度进行拆解,以及国产存储与新型存储技术的潜在机会。