【模型】Ollama + Open WebUI - Ubuntu

Ollama环境

Ollama 0.9.6, Open WebUI, Ubuntu 22.04

Anaconda,Pytorch 2.5,Cuda 12.4,cuDNN 9.0,Python 3.11

PyCharm,VSCode,百度网盘

访问OpenWebUI

系统创建好后可通过OpenWebUI访问进行操作

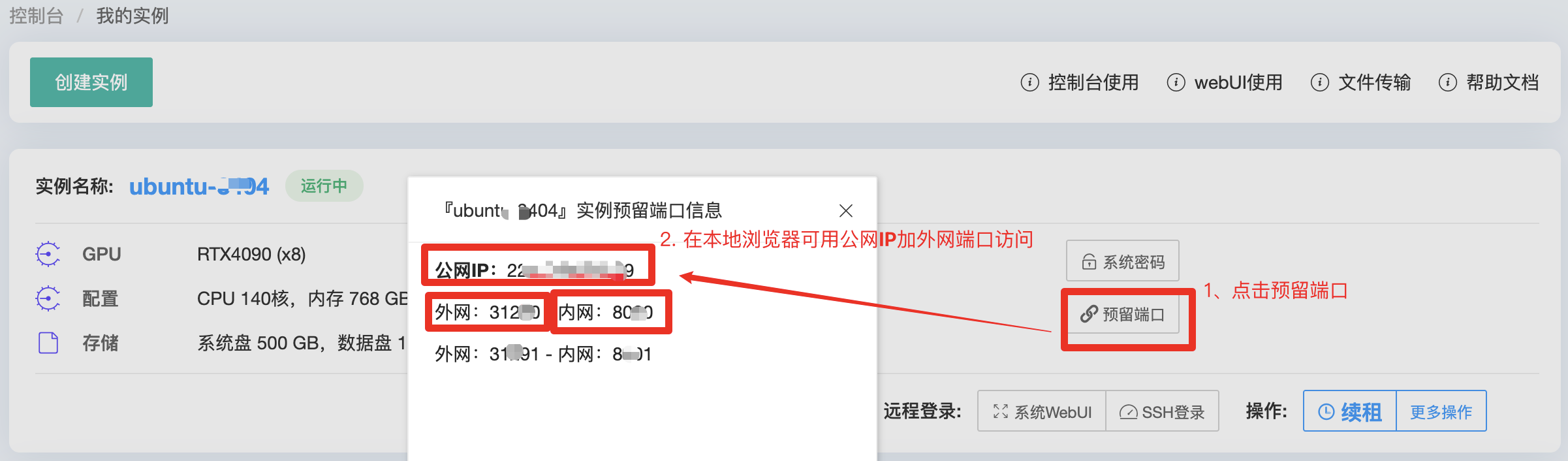

查看访问地址,默认监听到内网8000端口,可通过

8000对应的外网端口访问

控制台上查看IP,预留端口

默认用户名: admin@mornai.cn

密码: admin

注:可登录后修改、添加用户名密码

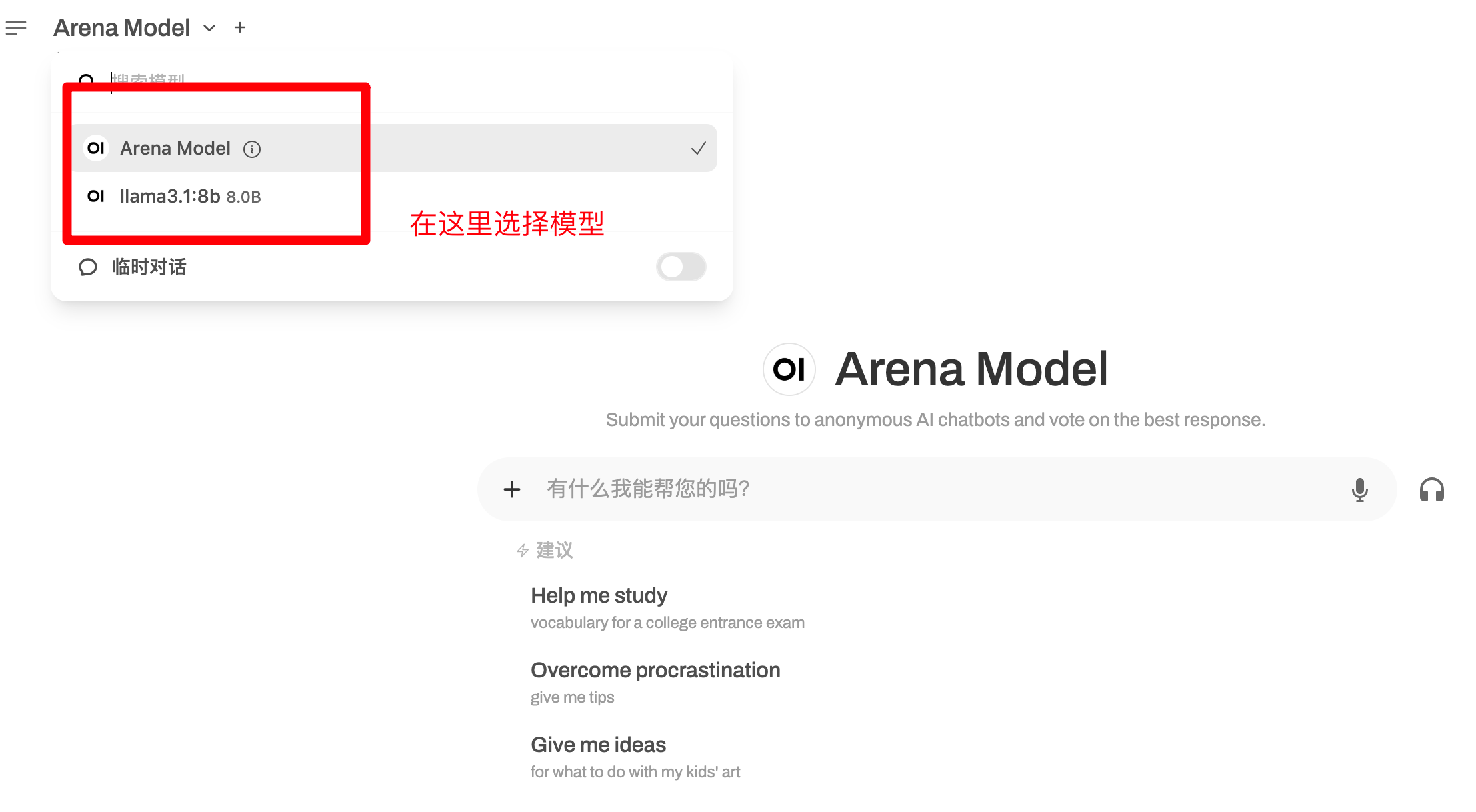

登陆后可以选择对话模型如下图,需要更多模型可以下载使用

访问Ollama API

Ollama API 默认监听到内网8001端口,可通过8001对应的外网端口访问

控制台上查看IP以及8001对应的外网端口

下载模型

查看官方模型列表

SSH登录服务器通过命令行Pull模型

OpenWebUI中可选择以pull的模型

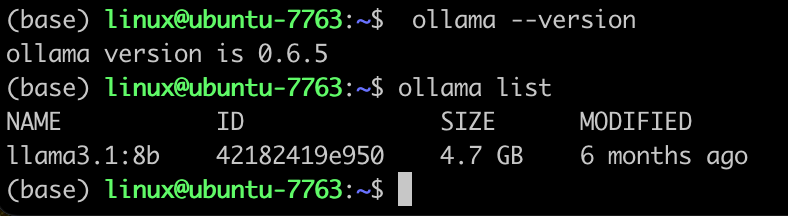

查看模型

WebUi可以通过页面左上角查看,命令行通过执行 ollama list 查看

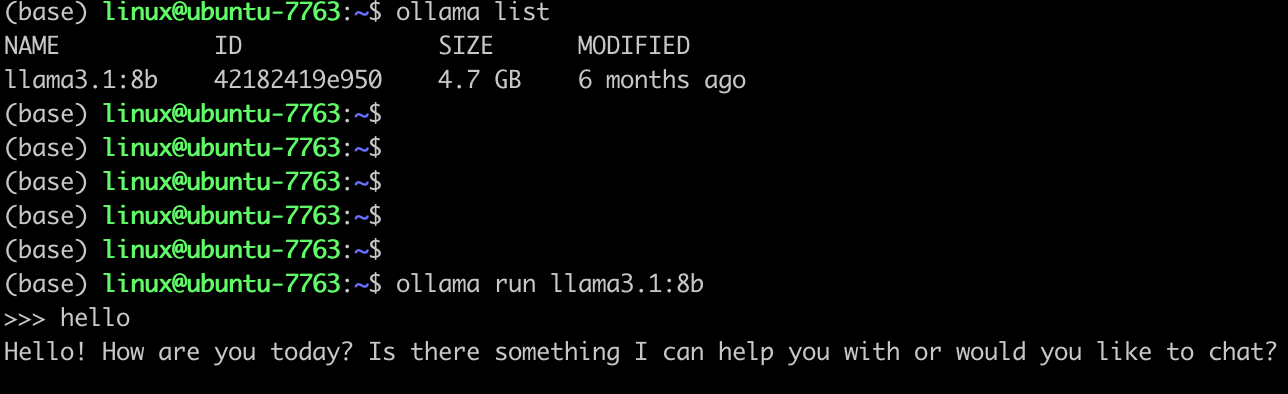

运行模型

命令行输入一下命令运行模型,我们通过上一步查看有模型 llama3.1:8b,就可以通过 ollama run llama3.1:8b 去运行模型

运行需要等待加载完成,就可以进行对话了

Open WebUI API

创建API KEY

在Open WebUI设置中创建API KEY

Ollama 配置

1)编辑ollama 的启动参数:

sudo vim /etc/systemd/system/ollama.service

具体参数如下,根据需要选择:

GPU资源配置实例:

Environment="OLLAMA_SCHED_SPREAD=1" 使用多卡

Environment="CUDA_VISIBLE_DEVICES=0,1" 使用双卡

其他更多参数可以查询官方文档

2)保存退出后,重新加载配置文件:

systemctl daemon-reload

3)重新启动ollama :

sudo systemctl restart ollama

4)再次加载qwen2.5-32B:

ollama run qwen2.5-coder:32b

模型路径 /usr/share/ollama/.ollama/models