晨涧云文档

首页

目录

- GPU算力租用流程

- Ubuntu查看显卡GPU利用率

- Ubuntu系统安装CUDA Toolkit + Cudnn

- Ubuntu NVIDIA显卡驱动安装

- Ubuntu用户界面入门

- Windows jupter notebook 的使用

- Windows 安装SSH Server

- windows查看显卡GPU利用率

- Ubuntu镜像

- Windows镜像

- CentOS镜像

- 深度学习 - Ubuntu

- 深度学习 - Windows

- ComfyUI - Ubuntu

- LLaMA Factory - Ubuntu

- Stable Diffusion - Ubuntu

- Ubuntu 命令行使用

- ComfyUI - Windows

- LLaMA Factory - Windows

- Stable Diffusion - Windows

- 秋叶Stable Diffusion - Windows

- Ollama - Windows

- Ollama DeepSeek - Ubuntu

- 【模型】Ollama + Open WebUI - Ubuntu

- 【语音】 Whisper 语音转文本 - Ubuntu

- Chatbox - Windows

- Ubuntu系统安装远程连接工具

- Windows登录方式

- 晨涧云概览

- 晨涧云简介

- 名词术语

- 安装显卡驱动

- 连接失败处理

- 促销活动

- Miniconda3 容器镜像

- PyTorch 容器镜像

- TensorFlow 容器镜像

- GROMACS 容器镜像

- ComfyUI 容器镜像

- Matlab - Windows

- YOLO 容器镜像

- LLaMA-Factory 容器镜像

- Wan-ComfyUI 容器镜像

- Stable-Diffusion 容器镜像

- vLLM 容器镜像

- LAMMPS 容器镜像

- Ollama 容器镜像

- Flux-ComfyUI 容器镜像

- ComfyUI应用

- Wan2.2文生视频显卡性能测试

- 深度学习场景

- 基于ResNet-50模型的显卡性能测试

- 大语言模型场景

- 使用vLLM测试大模型推理场景的显卡性能

- Qwen-ComfyUI 容器镜像

- vLLM大模型多卡推理场景显卡测试

- 科研仿真计算场景

- GROMACS分子动力学模拟计算显卡性能测试

- 【年终满减优惠活动】全系显卡算力特惠风暴!(A100除外)

- YOLO 模型训练显卡性能测试

- FluxGym-LoRA训练器 容器镜像

- Kohya_ss-LoRA训练器 容器镜像

- OpenClaw 容器镜像

- VSCode连接常见问题

- OpenClaw镜像 - Ubuntu

- OpenClaw镜像 - Windows

- OpenClaw应用

- OpenClaw本地Ollama模型调用实测

- OpenClaw创建飞书应用机器人实测

- OpenClaw晨涧云大模型API调用实测

- Ansys-Windows

- 学术资源加速

- 文件传输

- RustDesk远程连接

- 常见问题集

- RustDesk远程手机端设置

- PyCharm连接云主机

- WebUI使用

- 服务端口配置

- SSH隧道映射端口

- VSCode连接到云主机

- conda 安装虚拟环境

- 选择Conda虚拟环境

- 安装tensorflow

- huggingface下载模型

- 晨涧云服务协议

- 晨涧云反挖矿协议

- 晨涧云平台手册

- Windows操作

- GPU算力操作流程

- 云容器租用流程

- 系统预装环境

- Ubuntu操作

- 云容器控制台使用

- 云主机控制台使用

- JupyterLab使用

- 云主机镜像中心

- 云容器百度网盘使用

- 云容器

- 云容器按小时计费

- 云容器镜像

- 常见问题(FAQ)

- 常用操作

- 技术相关

- 应用场景

- 服务协议

- 晨涧云新老用户专享福利

- 微信登录立享6元优惠券

- 晨涧云产品重磅升级:云容器按量计费+控制台实例管理全新改版,重塑AI开发效率与成本体验

- 新容器镜像来了!宝藏镜像库+秒级部署,GPU直接8折!

- 【双十一显卡狂欢】🔥NVIDIA 3090/3080 史低八折!性能猛兽,价格温柔!

- 开学季|3090显卡专属福利🎯(2025年9月)

OpenClaw本地Ollama模型调用实测

OpenClaw支持调用Ollama模型,配置相当简单,运行起来也很流畅

本文以晨涧云OpenClaw云主机/云容器,Ollama云主机为例,介绍详细配置流程

创建Ollama云主机

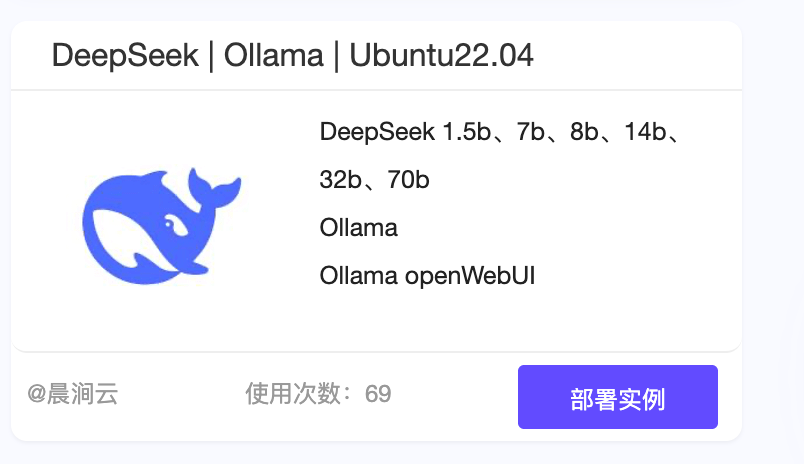

晨涧云的Ollama Deepseek 云主机,默认已经部署DeepSeek 、Qwen、Gemma4等热门模型

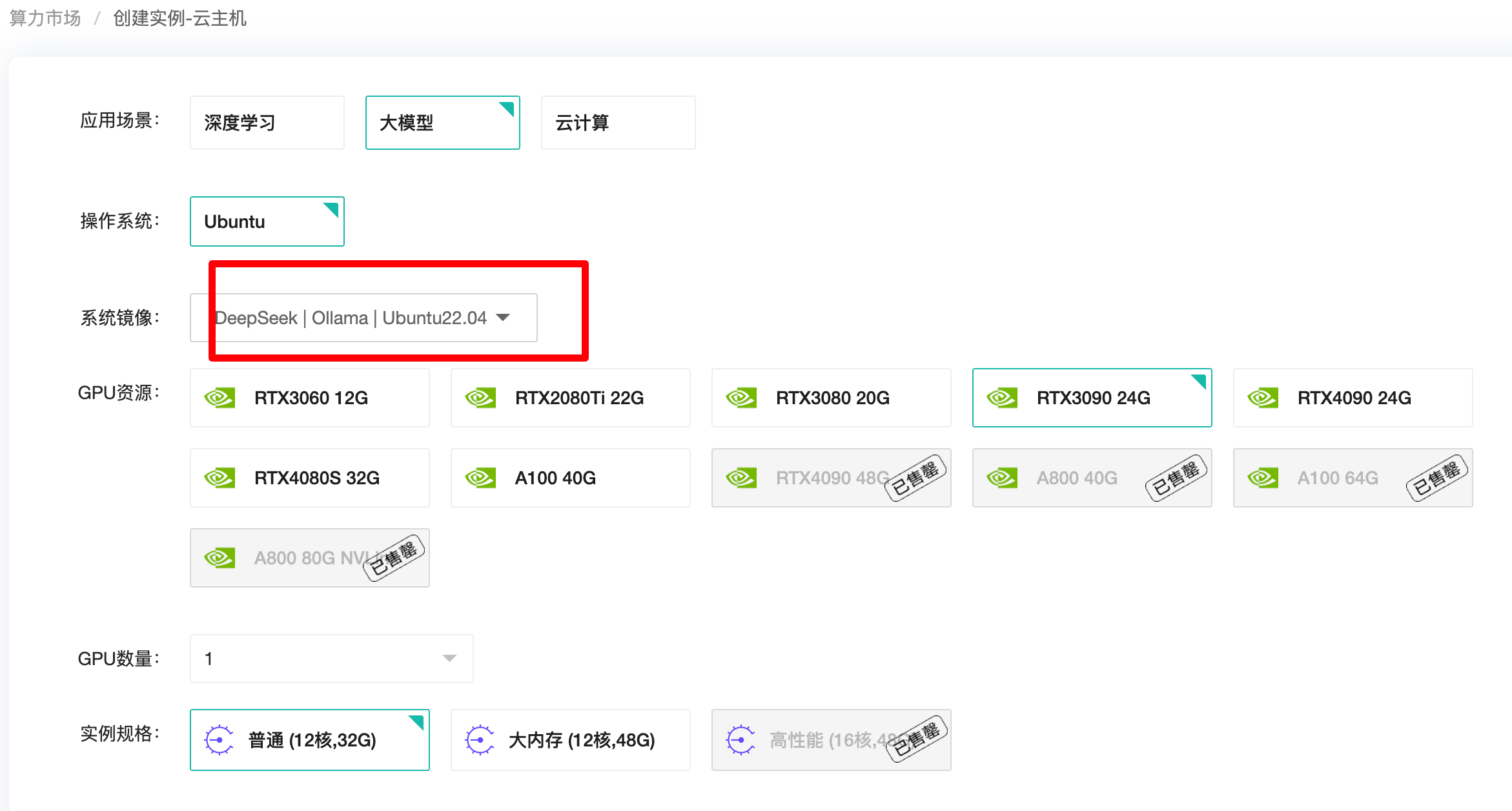

1、选择镜像 DeepSeek Ollama

2、创建实例

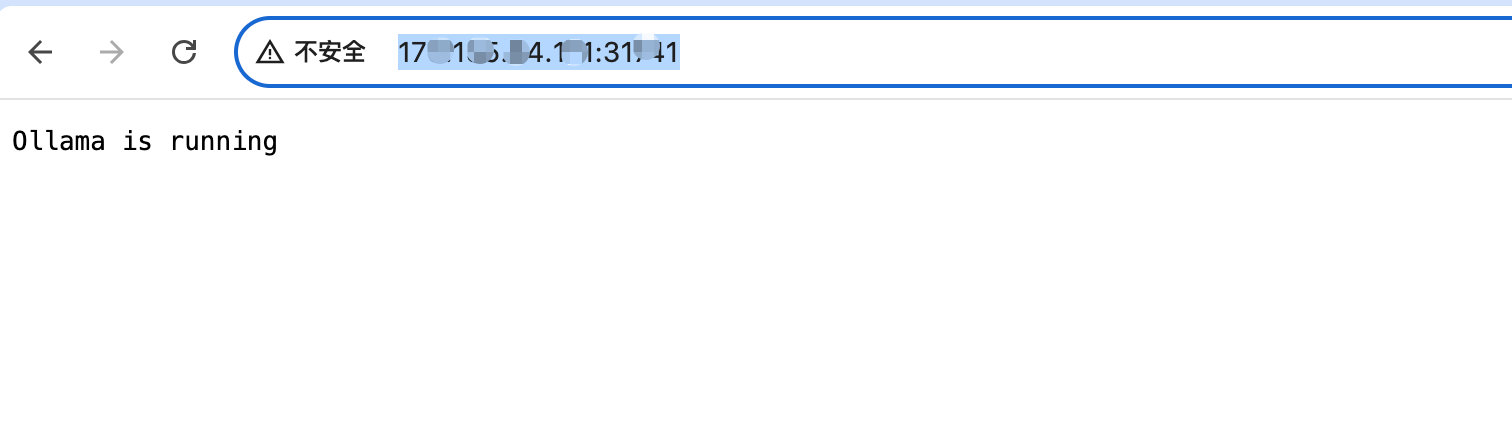

3、验证ollama api连接

创建完成之后,实例运行中,可以打开预留端口,通过IP:外网端口 ,浏览器访问ollama api

浏览器输出如下图所示

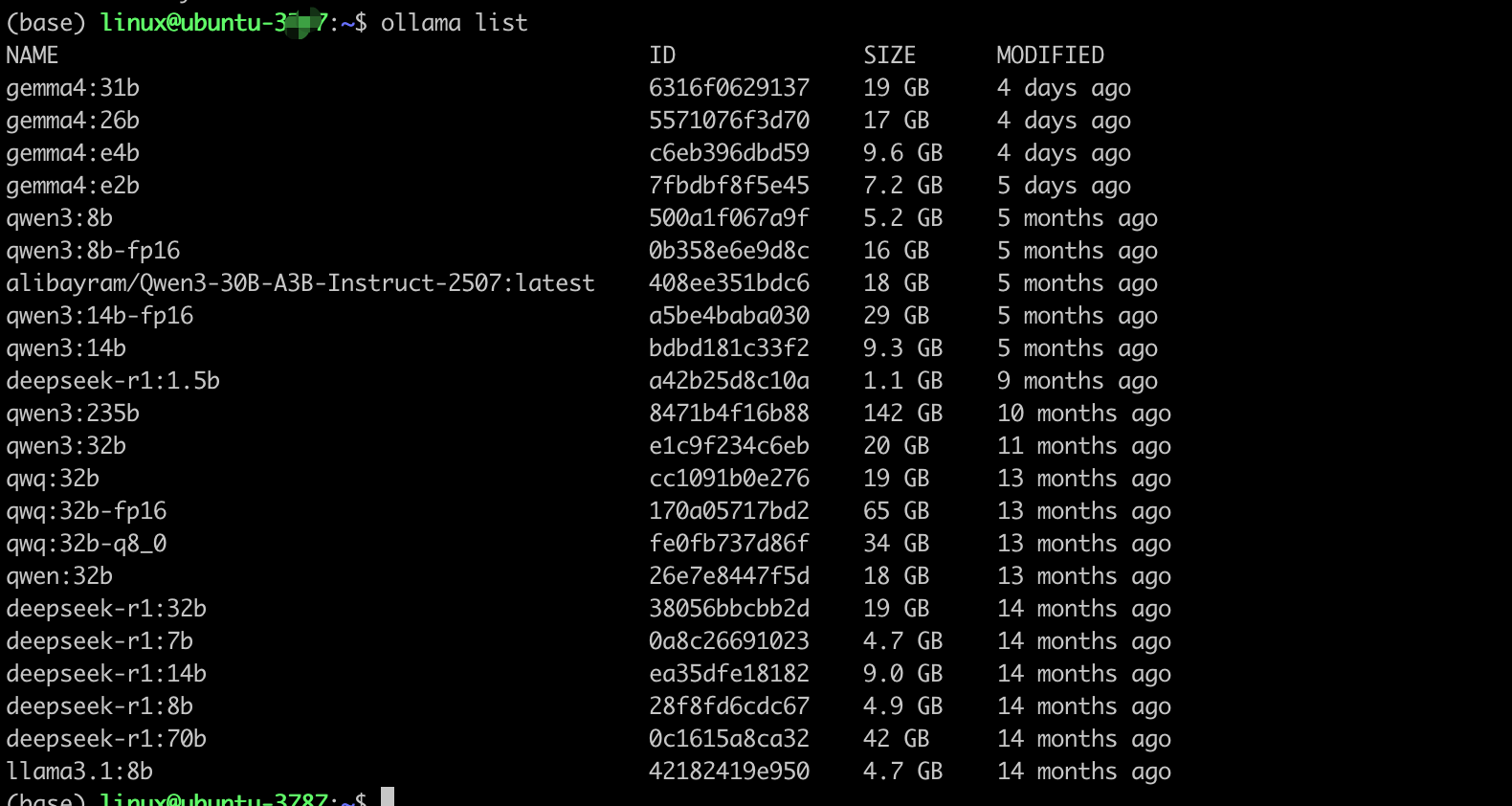

查看已经安装的模型方法

1、查看所有本地模型,Ollama 提供API:GET /api/tags

2、命令行运行 ollama list

创建OpenClaw云主机或云容器

OpenClaw云容器创建和使用参考 : OpenClaw云容器

OpenClaw云主机创建和使用参考:OpenClaw镜像 - Ubuntu 或 # OpenClaw镜像 - Windows

修改OopenClaw默认模型配置

创建完成之后修改openclaw.json 配置, baseUrl和apiKey,然后选择合适的默认模型(agents.defaults.model.primary)

配置完成示例

"models": {

"mode": "merge",

"providers": {

"ollama-remote": {

"baseUrl": "http://IP:预留外网端口/v1",

"apiKey": "ollama-local-dummy-key",

"api": "openai-completions",

"models": [

{

"id": "gemma4:e2b",

"name": "gemma4:e2b",

"api": "openai-completions",

"reasoning": true,

"input": [

"text"

],

....此处省略

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "ollama-remote/gemma4:e2b"

},

"models": {

"ollama-remote/gemma4:e2b": {

"alias": "ollama-remote gemma4:e2b"

}

},

"workspace": "/home/linux/.openclaw/workspace",

"compaction": {

"mode": "safeguard"

}

}

},配置完成 重启OpenClaw服务

报auth错误 需要创建验证文件 内容如下 ~/.openclaw/agents/main/agent/auth-profiles.json

{

"providers": {

"ollama-remote": {

"apiKey": "ollama-local-dummy-key",

"baseUrl": "http://IP:预留外网端口",

"type": "ollama"

}

}

}命令行输入验证配置模型是否成功

openclaw models list --provider ollama-remote

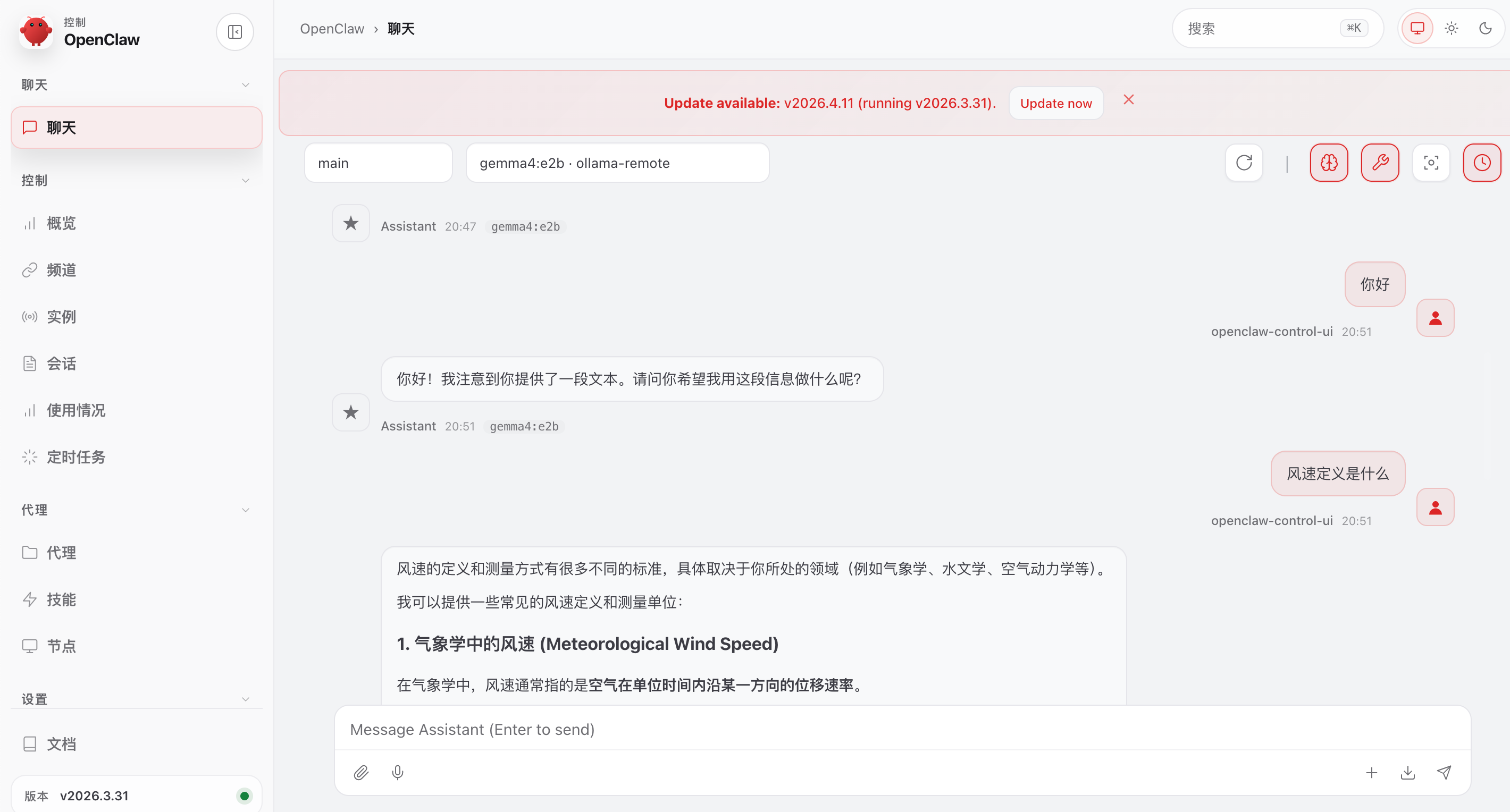

打开OpenClaw聊天窗口测试服务,实测响应速度非首次加载响应很快